GPT 5.3 코덱스 스파크 모델이 공개되었습니다. 아직은 연구 프리뷰 모델이긴 합니다.

작은 GPT 5.3 코덱스

이 모델은 GPT‑5.3‑Codex의 더 작은 버전이지만, 초당 1000 토큰 이상을 생성할 수 있을 정도로 속도를 극대화한 것이 특징입니다. 초저지연 하드웨어에 맞게 설계되어, 실제 개발 환경에서 코드를 수정하고 실행 결과를 바로 확인하는 실시간 협업에 특히 잘 맞다고 합니다.

코덱스 스파크는 긴 시간 동안 자율적으로 작업하는 기존 프론티어 모델과 달리, “지금 눈앞의 코드”에 빠르게 반응하는 데 초점을 맞춥니다. 코드 일부를 고치거나, 로직을 재구성하고, 인터페이스를 다듬는 등의 작업을 즉시 수행하며, 기본적으로는 작은 범위의 타깃 수정 위주로 움직입니다. 자동 테스트 실행도 사용자 요구가 있을 때만 진행하도록 가볍게 튜닝되어 있습니다.

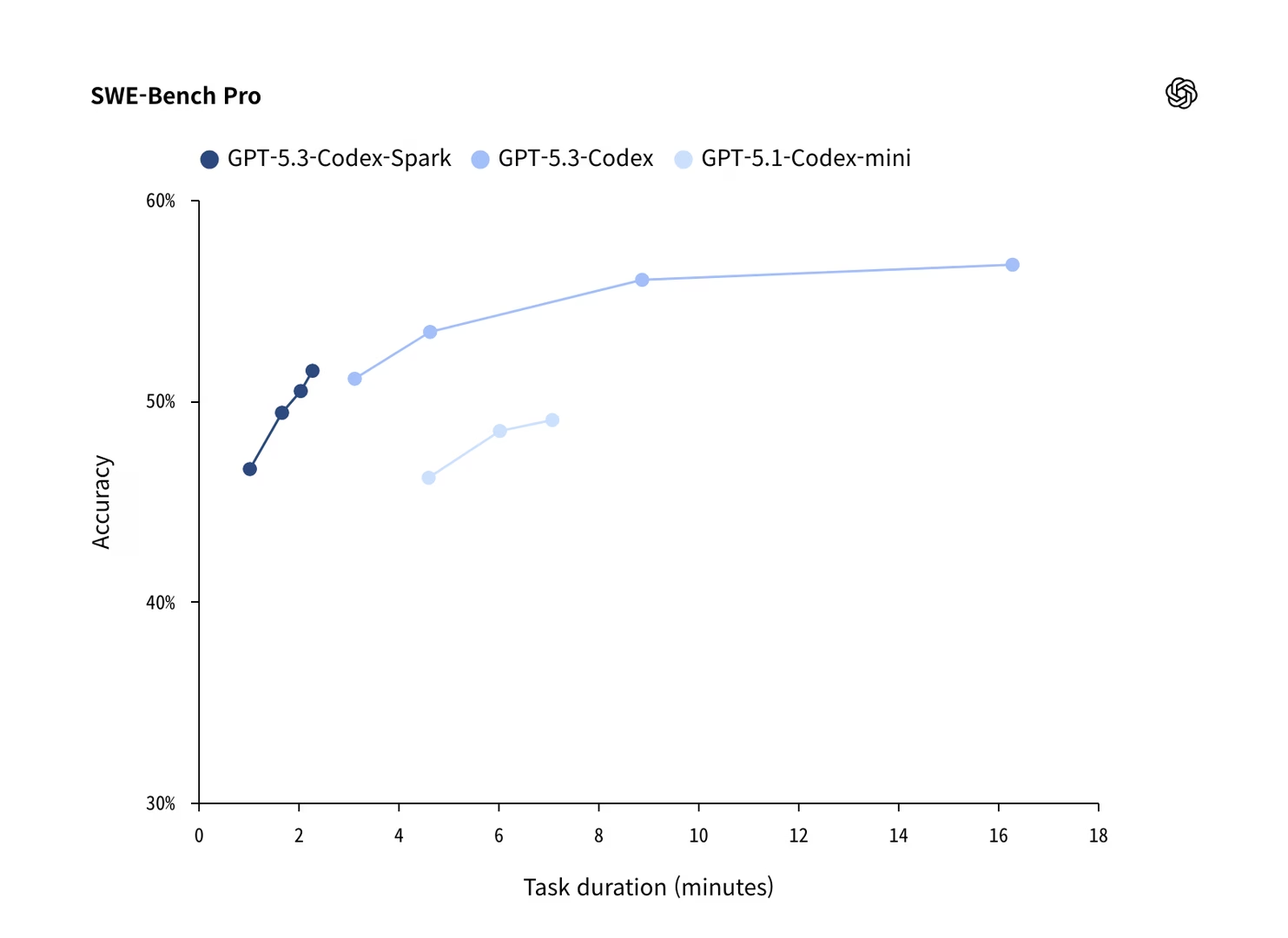

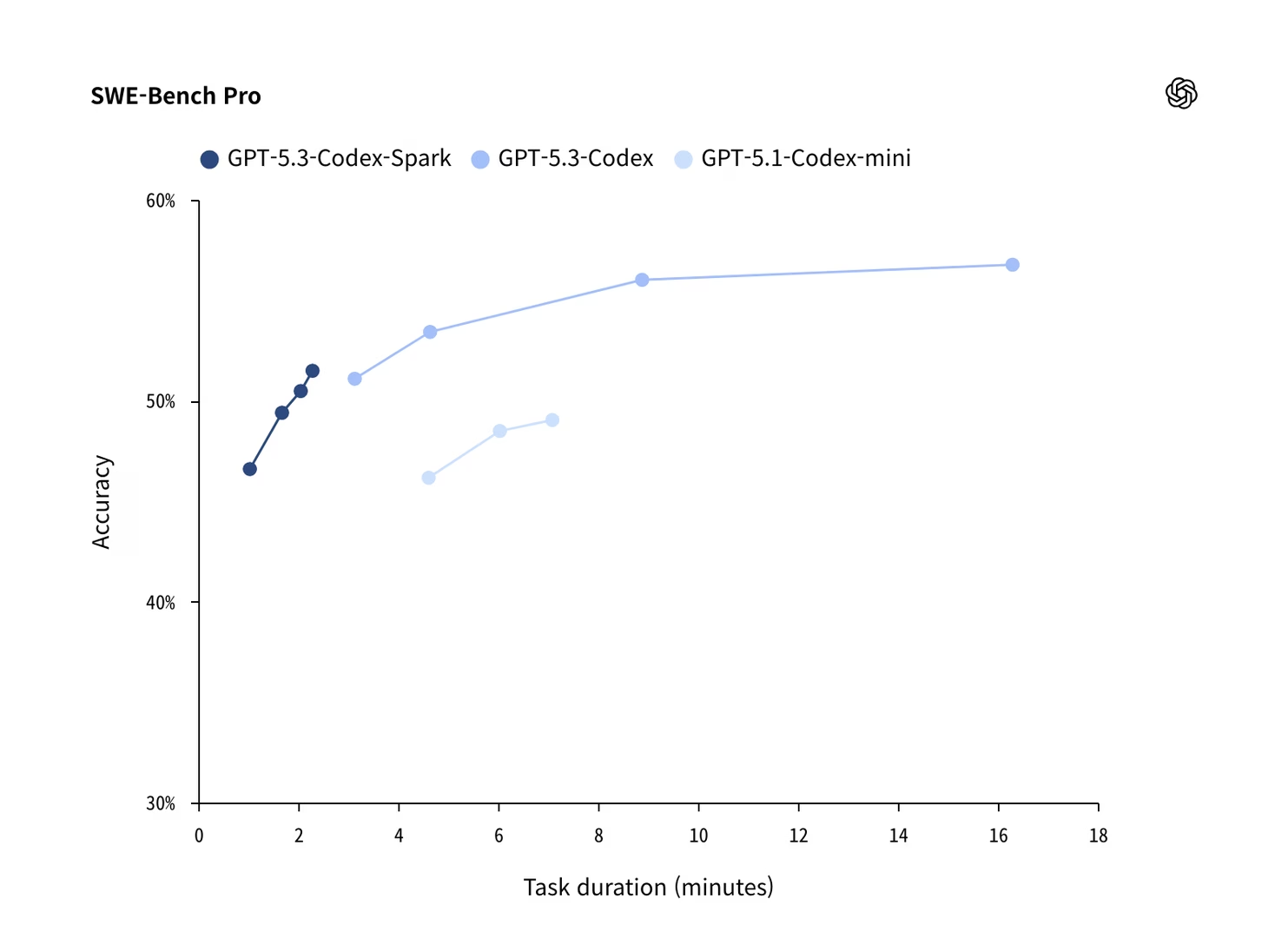

SWE-Bench Pro 그래프입니다.

모델은 128k 컨텍스트를 지원하는 텍스트 전용 모델이며, ChatGPT Pro 요금제 사용자를 대상으로 Codex 앱, CLI, VS Code 확장 등에 연구 프리뷰 형태로 먼저 제공됩니다. 이 단계에서는 별도의 사용 제한이 적용되고, 수요가 많을 경우에는 대기나 제한이 걸릴 수 있습니다. 일부 파트너에게는 API로도 제공해, 실제 제품에 어떻게 통합할지에 대한 피드백을 받고 있다고 합니다.

속도를 살리기 위해 OpenAI는 모델뿐 아니라 전체 요청–응답 경로도 함께 손봤다고 합니다. 스트리밍 방식, 세션 초기화, 네트워크 왕복 구조 등을 최적화해 첫 토큰이 보이는 시간과 토큰당 지연을 크게 줄였다는데요, 특히 지속적인 웹소켓 연결을 도입해 왕복 오버헤드를 줄이고, 응답이 끊김 없이 빠르게 흘러가도록 만든 점이 핵심입니다.

코덱스 스파크는 Cerebras의 전용 AI 칩 위에서 동작하는데, 이 하드웨어는 초저지연 추론을 위한 전용 가속기 역할을 합니다. GPU는 여전히 대규모 학습과 일반적인 추론에 중요한 역할을 하지만, Cerebras는 극도로 낮은 지연이 필요한 워크플로를 담당하는 식으로 서로 보완적인 구성을 이루게 됩니다.

이 모델은 기존 주력 모델과 동일한 안전 기준을 따르며, 특히 사이버 보안/생물학 관련 위험 수준이 내부 기준을 넘지 않는다고 평가되었습니다. OpenAI는 앞으로 코덱스를 '장기 실행 모드(기존 코덱스)'와 '실시간 협업 모드(이번 스파크 모델)'라는 두 축으로 발전시키겠다고 밝히며, 코덱스 스파크를 그 첫 단계로 제시합니다. 모델이 더 강력해질수록, 결국 사람과 모델 사이의 상호작용 속도가 병목이 되는데, 코덱스 스파크는 이 병목을 줄여 아이디어를 실제 소프트웨어로 옮기는 과정을 한층 자연스럽게 만드는 것을 목표로 합니다.

Link: https://openai.com/index/introducing-gpt-5-3-codex-spark/

댓글 0

댓글을 작성하려면 로그인이 필요합니다.

아직 댓글이 없습니다.