ollama를 설치하고, ollama에서 모델을 다운로드 했다는 것을 전제로 합니다.

- OpenCode 설정 폴더로 들어갑니다. 저의 경우(리눅스) 아래와 같았습니다:

~/.config/opencode - package.json이나 node_modules 등이 있는 디렉토리일텐데요, 거기에 opencode.json을 만들어줍니다. (즉, opencode/ 안에 바로 만들어줍니다. 최종적으로 package.json과 같은 위치입니다.)

- 아래처럼 작성해줍니다. 수정할 부분을 밑에서 말씀드리겠습니다.

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"ollama": {

"npm": "@ai-sdk/openai-compatible",

"name": "Ollama Local",

"options": {

"baseURL": "http://127.0.0.1:11434/v1"

},

"models": {

"devstral-small-2": {

"name": "Devstral Small 2 Local"

}

}

}

},

"model": "ollama/devstral-small-2:latest"

}

수정해야할 것은 아래와 같습니다.

- baseURL: 터미널에서 ollama serve하면 서브되는 url/v1 적어주시면 됩니다.

- models 안에 이름: 모델명과 같게 해줍니다. (콜론은 없어도 됩니다. 예: devstral-small-2)

- 그 안에 name: opencode에서 보여지는 이름이므로 직관적이게 적어줍니다.

- 맨 밑에 model: ollama/모델명으로 적어줍니다. (모델명에 콜론이 있다면 그대로 적어줍니다.)

모델명은 ollama serve 후 다른 터미널에서 ollama list하면 나오는 모델명을 의미합니다.

저(예시)의 경우 devstral-small-2:latest 입니다.

models 안의 키는 콜론을 제외한 모델명을

맨 밑에 model은 콜론을 포함하고 앞에 ollama/ 접두어를 붙여서 적어주시면 됩니다.

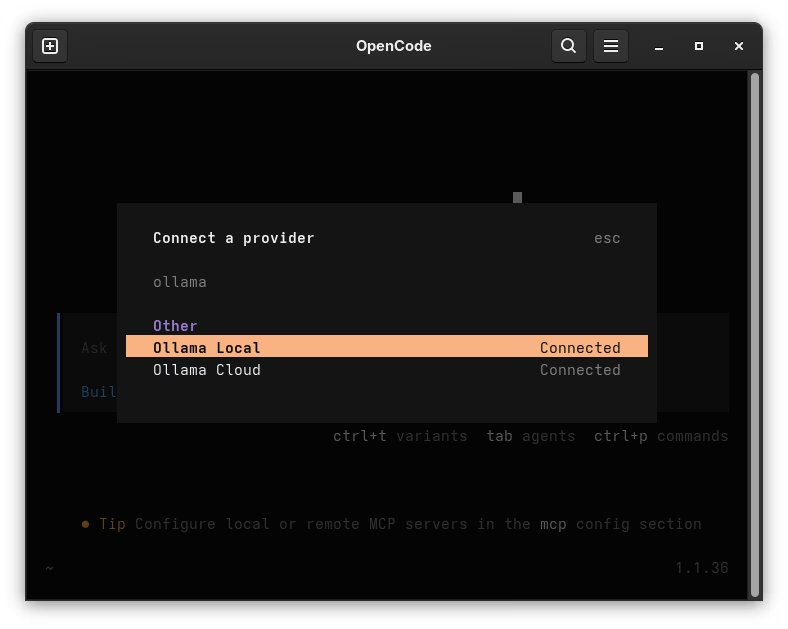

이렇게 하면 오픈코드에서 /connect로 연결할 때 아래와 같이 ollama local을 선택할 수 있습니다. (API키는 비어있는 상태나 공백 하나 넣고 그냥 엔터 눌러서 넘어가면 됩니다.)

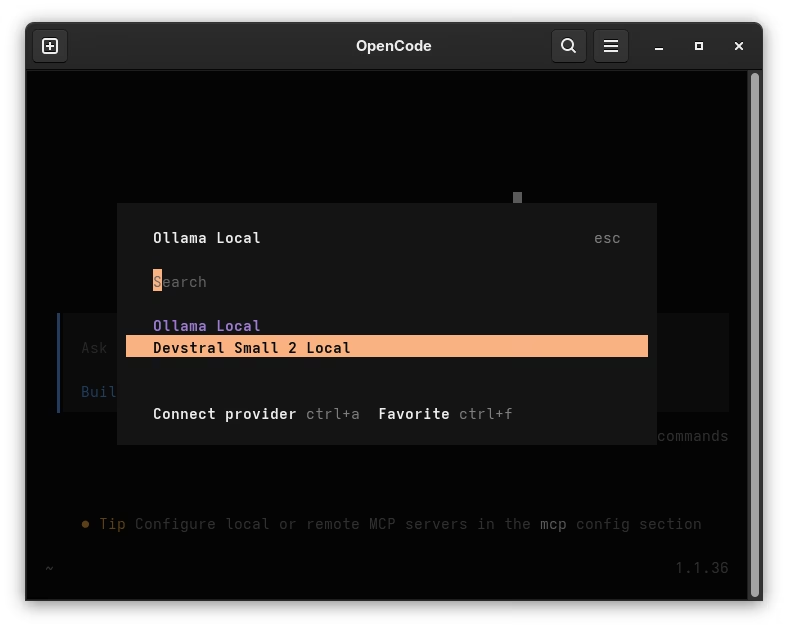

API 키 아무거나 치고 넘어가면(저는 스페이스바 한번 치고 엔터 눌렀습니다.) 아래와 같이 우리의 로컬 모델이 선택 가능합니다. ^^

물론 여러 로컬모델을 오픈코드에 넣으려면 설정 파일을 또 다르게 만져야겠지만, 저처럼 헤매지 않기를 바라며 글을 씁니다.

실제로 사용하려면 ollama serve후에 쓰시면 됩니다.

댓글 0

댓글을 작성하려면 로그인이 필요합니다.

아직 댓글이 없습니다.